ź╦źÕĪ╝źĒź┴ź├źū▄ć└ŌĪĪĪ┴żżżĶżżżĶ╚ŠŲ│öüż╬Įą╚ų(1-1)

ź»źķź”ź╔ŠW├ōż╬IoTźĘź╣źŲźÓż╬┐╩·tż╚Īóźėź├ź░źŪĪ╝ź┐▓“└ŽĪóGoogleĖĪ║„ż╩ż╔ż½żķ┐═╣®ē¶ē”Ī╩Artificial IntelligenceĪ╦żõź│ź░ź╦źŲźŻźųź│ź¾źįźÕĪ╝źŲźŻź¾ź░ż¼ÅRų`żĄżņżļżĶż”ż╦ż╩ż├żŲżŁż┐ĪŻ│žØ{ĄĪē”ż“Ęeż─┐═╣®ē¶ē”żŪżŽź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»ż╬źŌźŪźļżŪ│žØ{ĄĪē”Ī╩źŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░Ī╦ż“╝┬ĖĮżĘżŲżżżļĪŻAIż╬ź½ź«ż╚ż╩żļź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»ż╬źóĪ╝źŁźŲź»ź┴źŃżŽżŌż┴żĒż¾ĪóźĘźĻź│ź¾╚ŠŲ│öüæųż╦╝┬ĖĮż╣żļĪŻż│ż╬┤¾ąMżŪżŽĪóĖĄ╚ŠŲ│öü═²╣®│žĖ”ē|ź╗ź¾ź┐Ī╝Ī╩STARCĪ╦/┼ņėøż╬╚ŠŲ│öüź©ź¾źĖź╦źóżŪżóż├ż┐╝å└źĘ╝Ģ■ż¼ź╦źÕĪ╝źĒź┴ź├źūż╦ż─żżżŲ▓“└Ōż╣żļĪŻĪ╩ź╗ź▀ź│ź¾ź▌Ī╝ź┐źļįćĮĖ╝╝Ī╦

├°ŪvĪ¦ĪĪĖĄ╚ŠŲ│öü═²╣®│žĖ”ē|ź╗ź¾ź┐Ī╝Ī╩STARCĪ╦/ĖĄ┼ņėøĪĪ╝å└źĪĪĘ╝

żŽżĖżßż╦

ż│ż│1Ī┴2ŃQż╬źŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╬┐╩·tżŽż╣żążķżĘż»Īó▓ĪżĘ┤¾ż╗żļāSżŽż▐żĄż╦ĪųźŪźŻĪ╝źūźżź¾źčź»ź╚ĪūżŪżóżļĪŻŪ¦╝▒Ī╩▒ŪćĄĪó▓╗╠mĪóźŪĪ╝ź┐Ī╦żŪżŌ▒┐Ų░żŪżŌź©ź¾ź╔ź─Ī╝ź©ź¾ź╔żŪĮĶ═²ż“╣įż”żĶż”ż╦ż╩żļĪŻŲ■╬üĪ╩ź©ź¾ź╔Ī╦ż╚Įą╬üĪ╩ź©ź¾ź╔Ī╦ż╬┤ųż╦żŽĪųä┼Īūż╬źóźļź┤źĻź║źÓżŌĪó┐¶╝åŃQ═Ķرöü└ż─cż“ܦŪ█żĘż┐▒┐Ų░öĄµć╝░żŌĖ½ż©ż╩ż»ż╩żĻĪó╦¬żõ─╗ż╬══ż╦ź╔źĒĪ╝ź¾Ī╩┐╩▓ĮĘ┐Ī╦ż¼é}╚¬żõ╬ėż╬├µż“╚¶żėövżļżĶż”ż╦ż╩żļĪŻżóż├ż╚żżż”┤ųż╬┐╩▓Įż╬ź╣źįĪ╝ź╔ż╦żĶż├żŲĪųżėż├ż»żĻź▌ź¾ĪūėX▌åż╦ż╩żļĪŻżĄżķż╦ż│żņż½żķżŽśO╦²ż╬ä┼ż╬Č\żŌ╔į═ūż╚ż╩żĻĪóż│ż╬ż▐ż▐żŪżŽŠÅČ╚Ī”Č\ĮčĪ”Ė─┐═źņź┘źļżŪż╬źżź╬ź┘Ī╝źĘźńź¾źĖźņź¾ź▐ż¼╚»Ö┌ĪóĮjżŁż╩źŪźŻĪ╝źūźżź¾źčź»ź╚ż╦░¹ż▐żņżŲżĘż▐żżżĮż”ż└ĪŻ

żĶżĻ┴ŪÅ]ż»Ī╩2ĘÕ░╩æųż╬▓■║¤Ī╦ĪóżĶżĻŠ▄║┘żŪĪ╩ź│ź¾źŲź¾ź─Ū¦╝▒Ī╦Īó╠ź╬ü┼¬ż╩Ī╩╣ń└«Īó┐¦║╠¤²ż▒┼∙Ī╦ĪóĻUż╬┐╝żĄż¼żóżļĪ╩¾HŲ■╬üĪ╦ĪóżĘż½żŌŲ░żŁż“┬¬ż©śOć·▓Į▓─ē”ż╚ż╣żļĪ╩ź▐źļź┴źŌĪ╝ź└źļĪ╦Č╦żßżŲšlż½ż╩Ū¦╝▒Č\Įčż¼│╬╬®żĄżņżŲżżżļĪŻżĄżķż╦ż│ż╬└«Ė∙ż¼░·żŁČŌż╚ż╩żĻĪóżĶżĻśOć·└Łż“äė▓Įż╣żļ│žØ{öĄ╦ĪĪ╩äė▓Į│žØ{Ī╦ż¼▓├ż’żĻĪó┐ʿʿż▒┐Ų░╦Īō¦Ī╩ź©ź¾ź╔ź─Ī╝ź©ź¾ź╔Ī”źķĪ╝ź╦ź¾ź░Ī╦ż¼źŪźėźÕĪ╝Ī╩┤░└«Ī╦ż╣żļĪŻ┐═┤ųż╬ē¶╝▒Ī”ē¶įLż“Ø{įuż╣żļż▐żŪż╦╗Ļż├żŲż¬żķż║┐═╣®ē¶ē”ż╬─║żŁż½żķĖ½żļż╚2Ī┴3╣ńų`żŪżĘż½ż╩żżż¼ĪóĮjżŁż╩źėźĖź═ź╣ź┴źŃź¾ź╣ż“Ęeż─ź┘Ī╝ź╣źŁźŃź¾źūż╬Ų■Ė²ż╦╬®ż├żŲżżżļėX▌åż└ż╚żżż©żļĪŻ

żĄżķż╦┘J┘Tż╬╚ŠŲ│öü┤žŽóČ\Įčż╦×┤ż╣żļŗ╩¼┼¬ż½ż─╩±│ń┼¬ż╩Ė½─ŠżĘżŌ╠ź╬ü┼¬żŪżóżļĪŻ╬Ńż©żą▒Ū楿Ūż╬ź©ź¾ź│Ī╝ź╔ĪóźŪź│Ī╝ź╔Īóź╚źķź¾ź╣ź│Ī╝ź╔Īó╣ń└«Īóź╚źķź¾ź╣źšź®Ī╝źÓĪ╩MorphingĪ╦ĪóĖĪ║„Īóź╬źżź║Į³ĄŅ┼∙Ī╣ż“ĪóźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░żŪ║Ų╣Į├█ż╣żļż│ż╚żŌ│┌żĘżżż½żŌżĘżņż╩żżĪ╩┘Jż╦żõżķżņżŲżżżļĪ®Ī╦ĪŻ▓╗╠mĪóźŪĪ╝ź┐żŪżŌŲ▒══żŪĪóż▐ż┐─╣ŃQż╬▓▌¼öżŌ▓“»éżŪżŁżļż½żŌżĘżņż╩żżĪŻź╗ź¾źĘź¾ź░ż½żķŪ¦╝▒ż╬ŗ╩¼ż“╩±│ń┼¬ż╦Ė½─Šż╣ż│ż╚żŌČĮ╠Żżóżļ▓▌¼öżŪżóżļĪŻź╦źÕĪ╝źĒźŌźļźšźŻź├ź»/ź╦źÕĪ╝źĒźżź¾źšź®ź▐źŲźŻź»ź╣żõĪóÖ┌رĒn├Ņż▐żŪ£å╠Ņż╦Ų■żņż┐źąźżź¬ź▀źßźŲźŻź»ź╣żžż╬ÅR£åż¼źŁĪ╝ż╚ż╩żļĪŻ

╦▄╩¾╣ż╬╝ń─źżŽźĄźųź┐źżź╚źļż╦żóżļżĶż”ż╦ĪųżżżĶżżżĶ╦■ż“ĘeżĘżŲż╬╚ŠŲ│öüż╬Įą╚ųĪūżŪżóżļĪŻźĄĪ╝źąĪ╝ÅUżŽżŌż╚żĶżĻĪóź©ź├źĖÅUżžż╬·t│½ż¼╗Žż▐żļĪŻśOć·▒┐Ų░ÅUżõźŌźąźżźļźµźėźŁź┐ź╣ÅUĪ󿥿ķż╦żŽ┤─ČŁÅUĪ╩IoTĪ”Ī”Ī”Ī╦ż╚¾Hż»ż╬╩¼╠Ņż╦āSĄ┌żĘżĶż”ĪŻż▐ż┐║ŻĖÕż╬╚ŠŲ│öüż╬└’ĮčĪ”└’ŠS║÷─Ļż╬║ŅČ╚ż╬▀Mébż╚ż╩żņżąīmżżż└ż╚╣═ż©żŲżżżļĪ╩ÅRłį1Ī╦ĪŻżĮż╬║÷─Ļź╣ź│Ī╝źūżŽĘQĪ╣ż╬▌xŠņōļ░Ķż╦ż¬ż▒żļ×æēäĘ▓ĪųźßźŌźĻĪóźßźŌźĻ║«║▄Īóéb═²LSIĪ╩CPUĪ”GPUĪ”FPGAĪ”ź½ź╣ź┐źÓĪ╦ĪóIPĪóź╗ź¾źĄż╚ż╬═╗╣ń┼∙ĪūĪ󿬿ĶżėČ\ĮčĪ╩║Ó╬┴ĪóźŪźąźżź╣ĪóövŽ®Īóźčź├ź▒Ī╝źĖ/┴╚ż▀╬®żŲ┼∙Ī╦Ī󿥿ķż╦żŽ▌xŠņĪ”Ų░Ė■ż╦Ą┌żųĪŻ

ż│ż╬ĄŁĄ£żŽĪó¾Hż»ż╬┤žĘĖŪvż╦─Š└▄┼¬Īó┤ų└▄┼¬ż╦ż┤ČĄĶbżżż┐ż└żżż┐ŲŌ═Ųż“ź┘Ī╝ź╣ż╚żĘżŲżżżļĪŻØŖż╦2ż─ż╬╬«Ū╔Īų╦NĘ┐ĄĪ│Ż│žØ{źŽĪ╝ź╔ź”ź¦źóĪ╩ż╣ż╩ż’ż┴źŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░Ī╦ż╚ź╦źÕĪ╝źĒźŌźļźšźŻź├ź»╣®│žĪūż╬┘T║▀ż╬Ū¦╝▒żŽĪó╚ŠŲ│öüČ\ĮčŪvż╚żĘżŲµ£öüŪ─É█ż╬ż┐żßż╬┤┴├ē¶╝▒ż╚żĘżŲ─_═ūżŪżóżļĪ╩╗▓╣═½@╬┴1)ĪŻ░╩▓╝ż╬żĶż”ż╦╩¼ż▒żŲ╩¾╣ż“═Į─ĻżĘżŲżżżļĪŻ

ŗī1ŠŽĪ”Ī”Ī”ź╦źÕĪ╝źĒź┴ź├źūż“ŲDżĻ┤¼ż»▄ćČĘĪ┴żżżĶżżżĶ╚ŠŲ│öüż╬Įą╚ų(1-1)

ĪĪĪĪĪĪĪĪź╦źÕĪ╝źĒź┴ź├źūż“ŲDżĻ┤¼ż»▄ćČĘĪ┴żżżĶżżżĶ╚ŠŲ│öüż╬Įą╚ų(1-2)

ŗī2ŠŽĪ”Ī”Ī”źŪźŻĪ╝źūĪ”ź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»ż╬ź╦źÕĪ╝źĒź┴ź├źūżžż╬╝┬äóĪ┴żĮż╬┤¬ĮĻżŽ!!Ī┴

ŗī3ŠŽĪ”Ī”Ī”övŽ®źóĪ╝źŁźŲź»ź┴źŃĪóźŪźąźżź╣ĪóżĮżĘżŲĮø═ĶŲ░Ė■Ī╩▓Š¼öĪ╦

ŗī1ŠŽżŪżŽĪóźŪźŻĪ╝źūźķĪ╝źżź¾ź░Īóź╦źÕĪ╝źĒź┴ź├źūż╬║“║Żż╬ėXČĘż╦┤žżĘżŲ▄ć└Ōż╣żļĪŻŗī2ŠŽżŽĪó║Żövį~├▒ż╦Šę▓ż╣żļź╦źÕĪ╝źĒź┴ź├źūż½żķż▀ż┐źóźūźĻź▒Ī╝źĘźńź¾ż╬É║öü┼¬ż╩ĄĪē”ĪóĄ┌żė╝┬ä󿥿ņżŲżżżļźóźļź┤źĻź║źÓż╦┤žżĘżŲ▓─ē”ż╩šJ░ŽżŪż▐ż╚żßżŲ╩¾╣═Į─ĻżŪżóżļĪŻŗī3ŠŽżŪżŽĪóżĶżĻ╚ŠŲ│öüż╦ŖZżżź╣ź┐ź¾ź╣żŪ╩¾╣ż╣żļĪŻż╩ż¬Īó─_═ūż╩├ōĖņż╦┤žżĘżŲĪóĪ╩├ōĖņ▓“└ŌĪ╦ż“ż─ż▒ż┐ż╬żŪ═Įżßż┤▐kŲ╔żżż┐ż└żŁż┐żżĪŻ

├ōĖņ▓“└Ō

ź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»ĪóźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░Ī¦ ź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»ż╦┤žżĘżŲżŽĪóź╦źÕĪ╝źĒźŌźļźšźŻź├ź»Ī╩╝ńż╦ź╣źčźżźŁź¾ź░ź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»Ī╦żŌ┤▐żßżŲ╣ŁżżšJ░Žż╦┼¼├ō▓─ē”ż╩├ōĖņż└ż¼Īó║“║ŻżŽźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╚±Tżėż─ż▒żŲĖņżķżņżļ┤žĘĖż½żķż½ż╩żĻČ╣▒Iż╩┴T╠Żż╚żĘżŲ╗╚ż’żņżŲżżżļżĶż”ż└ĪŻéāżĻż╬ż╩żżĖ┬żĻźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╚ź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»żŽŲ▒żĖ├ń┤ųż╬Ė└±äż╚żĘżŲ╗╚├ōż╣żļĪŻ

│žØ{Ī╩learning)ż╚╝┬╣į(inference)Ī¦▒čĖņż╦┤žżĘżŲ│žØ{żŽtraining/learningżŪżóżļĪŻ╝┬╣įżŽ╝ńż╦inferenceĪ╩┬Šż╦Execution/runningĪ╦ż¼╗╚ż’żņżļĪŻż│ż╬┤žĘĖż½żķĪó╝┬╣įż╬┬Õż’żĻż╦ż▐żņż╦┐õébĪ╩inferenceĪ╦ż¼Ų³╦▄ĖņżŪ╗╚ż’żņżļż│ż╚żŌżóżļĪŻ╝┬╣įżŽĮų┤ų┼¬ż╦Į¬ż’żļż¼Īó│žØ{żŽ106Ī┴1010Ū▄ż█ż╔╗■┤ųż¼²Xż½żļĪŻźčźķźßĪ╝ź┐┐¶Ī▀│žØ{öv┐¶Ī╩╝²╠Jż▐żŪĪ╦Ī▀(│žØ{├ōż╬źĄź¾źūźļ)Ī▀”┴Ī╩¹|Ī╣ż╬ø]Į╠źŲź»ź╦ź├ź»Ī╦ĪŻ

ČĄ╗šŃ~żĻ│žØ{(supervised)ż╚ČĄ╗š╠ĄżĘ│žØ{(unsupervised)Ī¦║Żövż╬▓“└ŌĄŁĄ£żŪżŽĪóéāżĻż╬ż╩żżĖ┬żĻĪųČĄ╗šŃ~żĻ│žØ{Īūż“░Ęż”ĪŻ╣±ż¼ČĄ╗šż“░ķ└«żĘĪó│žē“żŪżĮż╬ČĄ╗šż¼│žÖ┌ż╦ē█äėż“żĄż╗żŲ│ąż©╣■ż▐ż╗żļż¼ĪóżĮż╬│žÖ┌ż¼╝┬╝ę▓±ż╦żŪżŲŲ»ż»Ī╩╝┬╣įĪ╦ż’ż▒żŪżóżļĪ╩╝┬║▌żŽČĄ╗šż╬┬Õż’żĻż╦ČĄ╗šźčź┐Ī╝ź¾ż“╗╚├ōżĘżŲ│žØ{ż╣żļĪ╦ĪŻ├”└■ż╣żļż¼Īó2012ŃQ(║Ż┐ČżĻ╩ųżļż╚ÜW▓╝╩¼ż▒ų`ż╬ŃQĪ╦░╩æT▓╝Üłż╦ż╩ż├żŲżżżļĪųČĄ╗š╠ĄżĘ│žØ{Īūż“Ė½─ŠżĮż”ż╚żżż”ĄĪ▒┐ż¼ÅŚż│ż├żŲżżżļ══żŪżóżļĪŻ

źĄĪ╝źąĪ╝ż╚ź©ź├źĖĪ¦źĄĪ╝źąĪ╝żŪżŽĪó│žØ{Ī╩╝┬╣įżŌĪ╦ż“ŪĪ▓┐ż╦╣ŌÅ]ż╦╣įż©żļż½!ĪĪż¼═Ż▐k║ŪĮjż╬┤ž┐┤Ą£żŪżóżļĪŻź©ź├źĖŖõżŪżŽĪó╝┬╣įż¼╝ńöüżŪĪó╣ŌÅ]└ŁżĶżĻżŌ─ŃŠ├õJż╩żĻĪóØŁ═ūż╩övŽ®æä╠Žż¼┤ž┐┤Ą£ż╚ż╩żļĪŻĪ╩ÅRĪ¦ź©ź├źĖźĻź├ź┴/╩¼Üg│žØ{ż╬╣═ż©öĄżŌżóżļĪ¦╗▓╣═½@╬┴2Ī╦

ŗī1ŠŽĪ¦ź╦źÕĪ╝źĒź┴ź├źūż“ŲDżĻ┤¼ż»▄ćČĘĪĪĪ┴żżżĶżżżĶ╚ŠŲ│öüż╬Įą╚ų

1.1 źóźļź┤źĻź║źÓ┐╩▓Į/źĘź╣źŲźÓ▒■├ōż╬╣Łż¼żĻżŽ╗ž┐¶┤ž┐¶┼¬

1.2 ╦■ż“ĘeżĘżŲ╚ŠŲ│öü┼ąŠņ

1.3 ź©ź├źĖÅUżŪż╬źėźĖź═ź╣·t│½ż¼▓├Å]ĪĪĪ┴┘ZĪóź╔źĒĪ╝ź¾ĪóźĒź▄ź├ź╚ śOć·ÅUż╬ŲDżĻ╣■ż▀żŌĪ┴

1.4 ─ŃŠ├õJ┼┼╬ü▓Į

1.5 2ż─ż╬╬«Ū╔ż¼żóżļż│ż╚ż“Š’ż╦Ū¦╝▒żĘżŲż¬ż»ØŁ═ūż¼żóżļ

1.6 ż▐ż└2╣ńų`Īó3╣ńų`ż╦┼■├ŻżĘż┐├╩│¼

1.1ĪĪźóźļź┤źĻź║źÓ┐╩▓Į/źĘź╣źŲźÓ▒■├ōż╬╣Łż¼żĻżŽ╗ž┐¶┤ž┐¶┼¬

Ę½żĻ╩ųżĘż╦ż╩żļż¼Īóźóźļź┤źĻź║źÓż╬┐╩╩Ōż╚żĮż╬▒■├ō╝┬Š┌·t│½ż╬Å]żĄżŽĪóźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╬║ŪØi└■ż╬Č\ĮčŪvż╬öĄżĄż©Č├ż»ż█ż╔Īó▓├Å]┼┘┼¬ż╦┐╩╩ŌżĘżŲżżżļż╬żŪżŽż╩żżż½ż╚╗ūż”ĪŻ▓▌¼ö▓“»éż▐żŪż╬Å]żĄĪó│ž▓±Ī╩┤▐żÓariXivĪ╦éb╩Ėż╬°P┐¶żõ┐╩▓Įż╬┼┘╣ńżżĪó└ż─cĪ”Ų³╦▄ĘQ├ŽżŪż▌ż¾ż▌ż¾ż╚╚»┐«żĄżņżļAI┤žŽóż╬Ė”ē|ĮĻż╬īÖŲ░ĪóżĮż”żżż├ż┐Š╩¾żŌ┤▐ż¾ż└ź”ź¦źųæųżŪż╬┤žŽóĄŁĄ£ż╬┴°Č°ż╬╔č┼┘ż╬╗\▓├┼∙Īóż▐żĄżĘż»╚®Ī╩Ų¼żŪĪ╦żŪ┐╩▓Įż╬┼┘╣ńżżĪ╩źżźßĪ╝źĖż╚żĘżŲżŽµ£└ż─cżŪ▓┐╦³Īó▓┐Ø▓╦³ż╬źŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░Č\ĮčŪvż¼┐▓┐®ż“╦║żņżŲż”ż┤żßżżżŲżżżļėXČĘĪ╦ż“┤ČżĖżļĪŻżĮż╬└¬żżżŽ2016ŃQż╦Ų■żĻż▐ż╣ż▐ż╣Ś„żĘż»ż╩ż├żŲżżżļĪŻż”ż┤żßżŁżŽ╝å╦³┐═æä╠Žż╬żĶż”ż╩Īóżżż’żµżļ╗ž┐¶┤ž┐¶┼¬żŪżóżļĪŻ

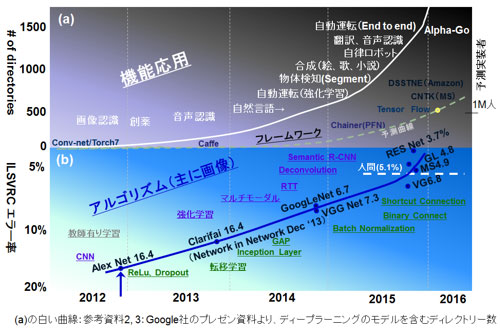

żĮż╬┤Č│ąż“─Ļ╬╠┼¬ż╦┐āżĘżŲżżżļżŌż╬ż¼ĪóGoogleż¼2015ŃQ¼Ź║óżĶżĻŠę▓żĘżŲżżżļĪųGrowing use of deep learning at GoogleĪūż╩żļ┐▐żŪżóżļĪŻź¬źĻźĖź╩źļżŽGoogleż╬╣ų▒ķ½@╬┴Ī╩╗▓╣═½@╬┴3Ī╦ĪóNIPS2015ż╬źŁĪ╝ź╬Ī╝ź╚ź╣źįĪ╝ź┴(╗▓╣═½@╬┴4)ż“╗▓Š╚żĘżŲżżż┐ż└żŁż┐żżĪŻźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╬źŌźŪźļż“┤▐żÓźŪźŻźņź»ź╚źĻĪ╝┐¶ż╬2012ŃQż½żķż╬╗\▓├ż“ź░źķźšż╦żĘż┐żŌż╬ż└ĪŻżĮż╬├═ż“┼Š║▄żĘż┐ź░źķźšż¼┐▐1(a)ż╬æų┐▐ż╬æųĖé└■(Ū“└■)ż╚ż╩żļĪŻ2015ŃQ¼Źż½żķ2016ŃQż╦²Xż▒żŲ╗ž┐¶┤ž┐¶┼¬ż╦╗\▓├ĪóĖ½żĶż”ż╦żĶż├żŲżŽ║Żż¼ØŖ░█┼└ż╦żŌĖ½ż©żļĪ╩ż┐ż└żĘĪóŪ“╩ĖÖCż╬ĄĪē”▒■├ōżŽØŁż║żĘżŌGoogleż╚żŽ┤žĘĖżĘżŲżżż╩żżĄ£╩┴żŌ┤▐ż¾żŪżżżļĪ╦ĪŻ

┐▐1Ī¦ (a) 2012ŃQ░╩æTż╬źŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╬·t│½ż╬ź╚źņź¾ź╔ż¬żĶżėźšźņĪ╝źÓź’Ī╝ź»ż╬╔ߥ┌

ĪĪĪĪ(b) 2012ŃQ░╩æTż╬ILSVRCżŪż╬ź©źķĪ╝╬© ▓■║¤ż╬┐õöĪ

ż│ż╬ØŖ░█┼└ż“╣═ż©żļż╚żŁż╦Īó═ū░°żŽżĶż»Ė└ż’żņżŲżżżļżĶż”ż╦Ī╩╗▓╣═½@╬┴7Ī╦░╩▓╝ż╦ż╩żļĪŻ

1.Imagenetż╬╣ūĖźĪ”Ī”Ī”┴R▒█żĘż┐┴╚“E╬üĪ╩źķź┘źļ¤²żŁźżźßĪ╝źĖ╠¾1400╦³ĮŚż“═╩ż╣żļĒöČ\▓±Ī╦

2.CNNźóźļź┤źĻź║źÓ┼∙Ī”Ī”Ī”╬╔żŁźóźļź┤źĻź║źÓ

3.GPGPUż╬╣ūĖźĪ”Ī”Ī”╬╔żŁźŽĪ╝ź╔

4.źšźņĪ╝źÓź’Ī╝ź»ż╬╣ūĖźĪ”Ī”Ī”╬╔żŁźĮźšź╚

ĪĪĪĪĪĪ-CNNĪ¦╝ńż╦▓ĶćĄŪ¦╝▒├ōż╦╗╚ż’żņżļøQ╣■ż▀ź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»Ī╩Convolutional Neural NetworkĪ╦

ĪĪĪĪĪĪ-ImagenetĪ¦ImageNet Large Scale Visual Recognition Competition ILSVRC ▓ĶćĄŪ¦╝▒ż╬ź¬źĻź¾źįź├ź»ĪŻ

żżż»ż─żŌż╬ĒöČ\ż¼żóżĻĪó║ŻövźŪĪ╝ź┐ż╚żĘżŲ╗╚ż├żŲżżżļż╬żŽ100mĒöČ\ż╦żŌ╔żØŌż╣żļ▐k╚╠رöüŪ¦╝▒ĪŻ

┐▐1Ī╩bĪ╦ż╦ĪóImagenetżŪż╬CNNż“ź┘Ī╝ź╣ż╚żĘż┐ź═ź├ź╚ź’Ī╝ź»żŪż╬▐k╚╠رöüŪ¦╝▒ż╬ź©źķĪ╝╬©Ī╩1000ź»źķź╣ż╬╗┼╩¼ż▒ĪóTop-5 ErrorĪ╦ż╬2012ŃQż╬Alex Net░╩æTż╬┐õöĪż“┐āż╣ĪŻAlex Netż╬NIPS2012żŪż╬▓±Šņż╬╩Ę░ŽĄżż╦┤žżĘżŲżŽĪ╩╗▓╣═½@╬┴5Ī╦ż¼Š▄żĘżżĪŻż▐ż┐¾Hż»ż╬Č\Įč├°Į±/Č\ĮčŠ╩¾┼∙ż¼żóżļĪ╩╗▓╣═½@╬┴6Īó7Ī╦ĪŻż│ż╬ĄŁŪ░╚Ļ┼¬ź═ź├ź╚ź’Ī╝ź»ż“ĖČ┼└ż╚żĘżŲĪóź©źķĪ╝╬©żŽ▓■║¤Īó2015ŃQż╦żŽ┐═┤ųż╬ź©źķĪ╝╬©5.1%ż“▒█ż©ż┐ĪŻźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╬┤╦▄┼¬ż╩Č\Įč│ū┐ĘĪ╩┐▐├µż╬£uÖCĪ¦ReLuĪóDropoutĪ”Ī”Ī”Ī╦ż╦ĘQĄĪ┤žż╬▓■║¤┼ž╬üĪ╩VGG Net/GoogLeNet┼∙Ī╣Ī╦ż¼żŌż┐żķżĘż┐ż┐żßżŪżóżļĪŻ║ŻĖÕżŽžM░ū┼┘ż¼╣Ōż»ż╩żļż╬żŪż╩żżż½ż╚żżż”Ążż¼ż╣żļĪ╩ÅRłį2Ī╦ĪŻ

ż│ż╬▓ĶćĄŪ¦╝▒ż╬CNNż¼╦ßż½żņżŲ═Ķżļż╚Ų▒╗■ż╦ĪóżŌż”▐kż─ż╬źóźļź┤źĻź║źÓż╬┐╩▓Įż╬╝┤ż╚żĘżŲĄĪē”└Łż╬Ė■æųż¼żóżļĪŻżĮż╬ĄĪē”└Łż╬Ė■æųż“Īó┐▐1Ī╩bĪ╦ż╬Č╩└■ż╬æųŖõż╦ĄŁżĘżŲżżżļĪŻØŖż╦CNNż╬ŽŲż“╔wżßżļ╣ŌĄĪē”▓Įż“ų`╗žżĘż┐źóźļź┤źĻź║źÓż╬┐╩▓Į(¾Hż»żŽ1980ŃQ┬Õż╬╚»£½ż¼żĮż╬ĖĄ)ż¼Īó▒■├ōż╬šJ░Žż“▐k┴ž╣Łż▓żŲżżżļĪŻ

ż│ż╬┐╩▓Įż╬āįµćżŪ─_═ūż╩┼└ż╦Īóźóźļź┤źĻź║źÓż“╝┬└ż─cæųż╦ź©ź▀źÕźņĪ╝ź╚ż╣żļźĮźšź╚ź”ź¦źóź─Ī╝źļżŪżóżļźšźņĪ╝źÓź’Ī╝ź»ż╬┘T║▀ż¼żóżļĪŻ┐▐1(a)ż╬īÜŖõż╦8ż─ż█ż╔ż╬źšźņĪ╝źÓź’Ī╝ź»ż“┼└║▀Īóż▐ż┐╝┬║▌ż╦ź─Ī╝źļż“╝┬äóżĘż┐┐═ż╬┐═┐¶ż╬„[─Ļź╚źņź¾ź╔ż“┐āżĘż┐ĪŻĄŅŃQżĶżĻĪóŲ³╦▄ż╬PFN ╝ę(│¶╝░▓±╝ęPreferred Network)ż╬ChainerĪóGoogleż╬TensorFlowĪóMSż╬CNTKĪ󿥿ķż╦5ĘŅż╬Amazonż╬DSSTNEż╚ż│żŠż├żŲź¬Ī╝źūź¾▓ĮżĄżņżŲżżżļĪŻż│żņżķźšźņĪ╝źÓź’Ī╝ź»ż╦żŽ┘J┘Tż╬ź═ź├ź╚ź’Ī╝ź»ż¼źķźżźųźķźĻĪ╝ż╚żĘżŲŲ■ż├żŲżżżļżŌż╬żŌ¾Hż»Pythonż╦┤žżĘżŲē¶╝▒ż╬żóżļČ\ĮčŪvż╩żķ║ŻŲ³ż½żķżŪżŌĪó├°ć@ż╩ź═ź├ź╚ź’Ī╝ź»(╬Ńż©żąAlexNet)ż“śO╩¼ż╬źčźĮź│ź¾æųż╦╝┬äóżŪżŁżļĪ╩╗▓╣═½@╬┴8Ī╦ĪŻż│ż╬±T▓╠ĪóźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╦ź┐ź├ź┴żĘż┐Č\ĮčŪvżŽµ£└ż─cżŪ╝å╦³┐═Ī╩╗▓╣═½@╬┴9Ī╦ż“Ę┌ż»▒█ż©ż┐ż╚═Į„[żĘżŲżżżļĪŻ

µ£öüż“▄ććĶż╣żļż╚źŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╬╗┼══ż╚öĄĖ■└ŁżŽ░╩▓╝ż╬══ż╦╔wż▐ż├żŲżŁżŲżżżļĪŻ

- źšź¦Ī╝ź║Ż▒ (2012ŃQ)Ī”Ī”Ī”CNN ▓ĶćĄŪ¦╝▒ż╦ż¬żżżŲAlexNetż¼ImagenetżŪØiŃQż“æųövżļ┘ć▓“╬©ż“├Ż└«

- źšź¦Ī╝ź║2 (2014ŃQ)Ī”Ī”Ī”CNNż╬Š}╦Ī▓■╬╔ż╚ĪóCNNż╬ŽŲż“╔wżßżļźóźļź┤źĻź║źÓż╬┐╩▓Įż╚śOć·ÅUż╬┼¼├ō

ĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪRNN (Recurrent neural network)Ī”Ī”Ī”║ŲĄóĘ┐ź╦źÕĪ╝źķźļź═ź├ź╚Ī╩╗■ÅUš`źŪĪ╝ź┐ĮĶ═²Ī╦

ĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪĪRL (Reinforcement learning)Ī”Ī”Ī”äė▓Į│žØ{(╣įŲ░źčź┐Ī╝ź¾ż╬äė▓Į)

- źšź¦Ī╝ź║3 Ī╩2015ŃQĪ┴Ī╦ źšźņĪ╝źÓź’Ī╝ź»ż╬ź¬Ī╝źūź¾▓Į ChainerĪóTesorflowĪóCNTKż╩ż╔

ż│żņżķż“ĘQź╣źŲź├źūż╚żĘżŲĪóĖĮ║▀ż╬2016ŃQż¼ØŖ░█┼└ż“Ę▐ż©żŲżżżļż╚╣═ż©żļż│ż╚ż¼żŪżŁżļĪŻ

żĄżŲĪóż│ż╬╬«żņżŪźŽĪ╝ź╔ź”ź¦źóĪó╚ŠŲ│öüż╬ź▌źĖźĘźńź¾żŽż╔ż”ż╩ż╬ż½ż¼ź▌źżź¾ź╚ż╚ż╩żļĪŻ - źšź¦Ī╝ź║4 Ī╩201xŃQĪ╦ źŽĪ╝ź╔ź”ź¦źóĪ╩Ī”Ī”Ī”Ī╦

ż│ż╬╩¼╠ŅżŽĖĮ╗■┼└NVIDIAż╬GPGPU/FPGAż¼╗╚ż’żņżŲżżżļĪŻż│ż╬┼└ż╦┤žżĘżŲżŽ╝Ī£IżŪ└Ō£½ż╣żļĪŻ

1.2ĪĪ╦■ż“ĘeżĘżŲ╚ŠŲ│öü┼ąŠņ

┐▐2ż╦ź╦źÕĪ╝źĒź┴ź├źū┤žŽóĪ╩┤▐Ī¦GPU/FPGAĪ╦ż╬║ŪŖZż╬Ų░Ė■ż“┐āż╣ĪŻų`┼¬╩╠ż╦3¹|╬Óż╦╩¼ż▒żķżņżļĪŻ

- ╦N┐└Ęą▓╩│ž═²▓“ż╬ż┐żßż╬ź╦źÕĪ╝źĒźŌźļźšźŻź├ź»Ī╩Ö┌öü══Ī╦ź┴ź├źūĪ¦┐└Ęąź═ź├ź╚ź’Ī╝ź»źŌźŪźļż“ĮĖ└čövŽ®æųż╦║Ų╣Į├█żĘżŲĄšż╦╦NĄĪē”ż“▓“£½żĘżĶż”ż╚ż╣żļż│ż╚ż“ų`┼¬ż╚żĘż┐źĘź▀źÕźņĪ╝ź┐Ī”ź©ź▀źÕźņĪ╝ź┐ź┴ź├źūĪ╩╗▓╣═½@╬┴1ż¬żĶżė ╝Īöv1.5£IĪ╦ĪŻ╦Nż╬╣Ō└Łē”Ī”╣ŌĄĪē”└Łż╬╝┬äó▓─ē”└Łż“╚ļżßż┐╩¼╠ŅżŪżóżļĪŻØŖż╦IBMż╬TrueNorthżŽź©ź├źĖ▒■├ōĪ╩ż╚żĻżóż©ż║żŽĪ╦ż“ź┐Ī╝ź▓ź├ź╚ż╚żĘż┐źšźķź├ź░ź┴ź├źūż╚żĘżŲż╬└Ł│╩żŌĘeż┴╣ńż’ż╗żŲżżżļĪ╩ÅRłį3Ī╦ĪŻż╩ż¬ĪóźŪźąźżź╣│½╚»żŽīÖ╚»żŪ║“ŃQ12ĘŅż╬IEDMżŪżŽ2ż─ż╬ź╗ź├źĘźńź¾ż¼ż│ż╬╩¼╠Ņ┤žŽóż╚ż╩ż├żŲżżż┐ĪŻ

- ź©ź├źĖ├ōź┴ź├źūĪ¦╝┬╣įż¼╝ńöüżŪ─ŃŠ├õJ┼┼╬ü└Łż¼ØŁ═ūżŪżóżļĪŻ║ŻŃQż╦Ų■żĻ╚»╔Įż¼ŠåŚ„ż╦╗\ż©żŲżżżļĪŻ╝ĪövŠ»żĘŠ▄żĘż»Įęż┘żļĪŻ│žØ{├ōż¼1ź┴ź├źūżóżļ(KAIST2015 ISSCC)ĪŻ

- źĄĪ╝źąĪ╝├ōź┴ź├źūĪ¦│žØ{├ōżŪ╣ŌÅ]└Łż¼ŗī▐kĪŻźŪĪ╝ź┐ź╗ź¾ź┐Ī╝├ōżŪĪó“£═Ķż╬CPUż½żķGPGPUżŌżĘż»żŽFPGAż╦└┌żĻü÷ż’żĻż─ż─żóżļĪŻźßźŌźĻźąź¾ź╔╔²ż“│╚ĮjżĘż┐öĄ╝░Ī╩HBM2ó¬P100ĪóXilinxĪ╦ż¼Č\Įčż╬ų`Č╠żŪżóżļĪŻżĮżņ░╩│░żŽĪó├µ╣±▓╩│ž▒ĪĪ╩CASĪ╦ż╬DaDianNaożŪĪó2014ŃQ12ĘŅ(MICRO47)ż╦╚»╔ĮżĄżņż┐DRAM║«║▄ż╬│žØ{├ōź┴ź├źūĪ╩Machine Learning Super ComputerĪ¦ CADź┘Ī╝ź╣Īóź┴ź├źū▓ĮżŽ╝Ŗ▓Ķż╬ż▀Ī╦żŪżóżļĪŻ║Ū┐Ęż╬Teslaź┘Ī╝ź╣ż╬GPUĪ╩P100Ī╦żĶżĻżŌ10Ū▄µć┼┘ż╬╣ŌÅ]└Łż¼żóżĻĪóźčź’Ī╝żŌ▐kĘÕ░╩æųŠ«żĄżżĪŻż▐ż┐5ĘŅ18Ų³ż╬Google I/O 2016ż╦żŲGoogleż╬ź½ź╣ź┐źÓź┴ź├źūTPU (Tensor Processing UnitĪ¦Tesorflowż╦×┤▒■)ż╦┤žżĘżŲż╬╚»╔ĮĪ╩ź┴ź├źūżŽ1ŃQØiĪ╦ż¼żóż├ż┐ż¼Š▄║┘żŽ╝Īöv░╩æTż╦╩¾╣ż╣żļ═Į─ĻĪŻ

┐▐2Ī¦ĪĪź╦źÕĪ╝źĒź┴ź├źū┤žŽóż╬║ŪŖZż╬ź╚źņź¾ź╔

ÅRłį1Ī¦„[─Ļ▌xŠņĪóĄĪē”ż╚╚ŠŲ│öü┤žŽóż╬Ą£╣Óż╚ż╬┤žŽó┐▐ĪŻĪĪĪ²Ī”Ī”Ī”Ń~żĻĪóĪ¹Ī”Ī”Ī”▓─ē”└ŁŃ~żĻĪóȧŪ“Ī”Ī”Ī”╔į£½

ÅRłį2:┐═┤ųż╬▓Ķ楿╬ź»źķź╣╩¼ż▒ż╬Ū¦╝▒Ī╩╬Ńż©żąĪóż│ż╬└^┐┐żŽ╠Ņ╬╔ŪŁżŪżŽż╩ż»źĘźŃźÓŪŁż└Ī¬ż╚┼÷żŲżļĪŻ╝┬║▌żŽ1000ź»źķź╣ż╬╗┼╩¼ż▒ĪóTop-5 ErrorĪ╦ē”╬üż¼ź©źķĪ╝╬©5.1%ż╬żĶż”ż└ż¼Ī╩╗▓╣═½@╬┴7Ī╦ĪóżĮżŌżĮżŌ┘ć▓“Ī╩Ground TruthĪ╦żŌ┐═┤ųĪ╩1ć@ż╬±T▓╠Ī®Ī╦ż¼═┐ż©żŲżżżļż╬żŪ5.1%░╩▓╝żŽ┘ć▓“ż╦żŌ│╬╬©Ī╩ź¼ź”ź╣╩¼╔█Ī╦ż¼²Xż½ż├żŲżżżļżŽż║ĪŻż╚żżż”ż│ż╚żŪĮj╗©Ū─ż╦1”ę░╠ż╬3.4%ż“ØŖ░█┼└ż╚żĘżŲź░źķźšżŽźūźĒź├ź╚żĘżŲżżżļĪŻŖZż┼ż▒żąžM░ū┼┘ż¼ż░ż├ż╚╣Ōż»ż╩żļżŽż║ĪŻ║ŻĖÕżŽ┬Šż╬ĒöČ\¹|ų`ż¼£ņĖ„ż“═ßżėżļż╬ż½żŌżĘżņż╩żżĪŻ

ÅRłį3:ź╦źÕĪ╝źĒźŌźļźšźŻź├ź»ź┴ź├źūż╬╣®│ž┼¬╝┬├ō▓Įż“żßżČżĘĪó╩╠ż╬╬«Ū╔żŪżóżļźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╬Č\╦Īż╬┼¼├ōż“ų`╗žż╣Ų░żŁż¼żóżļĪŻżĮż╬║▌ż╦2ż─ż╬▓▌¼öż¼żóżļĪŻĖĒ║╣Ąš┼┴ś“╦ĪĪųBP╦ĪĪ¦Back PropagationĪūż╬┼¼├ō╝┬Š┌ż╚źąźżź╩źĻĪ╝├═ż╬─Ļ╬╠┼¬▓“łįżŪżóżļĪŻż│ż│┐¶ź§ĘŅ(2015ŃQ11ĘŅĪ┴16ŃQ4ĘŅ)ĪóIBM śOżķż▐ż┐ĪóźŌź¾ź╚źĻź¬Ī╝źļĮj│žĪ╩BengioČĄĶbż╬ź░źļĪ╝źūĪ¦Binary Connect/Binarized networkĪ╦┼∙ż╬Ė”ē|żŪØi┐╩ż¼Ė½żķżņĪóŲ¾ż─ż╬╬«Ū╔ż╦▓═ż▒ČČż¼żŪżŁżĮż”ż╩╩Ę░ŽĄżż¼żóżļĪŻż╩ż¬ĪóźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╚ż╬▓═ż▒ČČż¼ØŁ═ūż½ż╔ż”ż½żŌĄ─ébż╬═Š├Žż╬żóżļ┼└żŪżóżļĪŻ

╗▓╣═½@╬┴

- └§░µ┼»╠ķ, Īųź╦źÕĪ╝źĒźŌźļźšźŻź├ź»╣®│žĪ”╦NĘ┐ĄĪ│Ż│žØ{źŽĪ╝ź╔ź”ź¦źóż╬╣įöĄĪū, Ų³╦▄┐└ĘąövŽ®│ž▓±╗’, Vol. 22 (2015) No. 4 p. 162-169. 2015ŃQ12ĘŅ

- ŃK╠ŅĖČĮj╩Õ, Īų║ŻĖÕ10ŃQż╬Š╩¾ĮĶ═²źóĪ╝źŁźŲź»ź┴źŃĪ╝ż“├ĄżļĪū, Ų³Ęąź©źņź»ź╚źĒź╦ź»ź╣, 95Ī┴105╩Ū, 2015ŃQ5ĘŅęÄĪŻ

- ║┤ŲŻ▐kĘ¹, Ī╚Machine Intelligence at Google Scale: Vision/Speech API, TensorFlow and Cloud Machine LearningĪ╔, 2016ŃQ4ĘŅ4Ų³

- Jeff Dean and Oriol Vinyals, Ī╚Large Scale Distributed Systems for Training Neural NetworksĪ╔, NIPS 2015 Tutorial

- ║┤ŲŻ░ķ╬r, ĪųźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░ż╬┘Z║▄▒■├ōż╦żÓż▒żŲĪū, 2016ŃQ1ĘŅ8Ų³

- ŃK├½šQŪĘ, Īų┐╝┴ž│žØ{Īū Ī╩ĄĪ│Ż│žØ{źūźĒźšź¦ź├źĘźńź╩źļźĘźĻĪ╝ź║Ī╦Īó╣ųÕi╝ęĪó2015ŃQ4ĘŅ8Ų³ĪŻ

- ├µæč▒č█`, Īų┐╝┴žøQż▀╣■ż▀ź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»ż╦żĶżļ▓ĶćĄØŖ─¦├ĻĮąż╚┼ŠöĪ│žØ{Īū, ┼┼╗ęŠ╩¾─╠┐«│ž▓±▓╗╠mĖ”ē|▓±7ĘŅĖ”ē|▓±, 2015. http://www.nlab.ci.i.u-tokyo.ac.jp/pdf/CNN_survey.pdf 2015ŃQ7ĘŅĪŻ

- æč▓╝╬┤▒I, Īųźżźķź╣ź╚żŪ│žżųźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░Īū, KSŠ╩¾▓╩│ž└ņ╠ńĮ±, ╣ųÕi╝ę, 2016ŃQ2ĘŅ22Ų³ĪŻ

- ITmediaź╦źÕĪ╝ź╣, ĪųGoogleż╚UDACITYĪóĪųTensorFlowĪūżŪ│žżųźŪźŻĪ╝źūźķĪ╝ź╦ź¾ź░╣ų║┬ż“│½└▀Īū, UDACITY£p╣ųŪvżŽ100╦³┐═ż“▒█ż©ż┐, 2016ŃQ1ĘŅ22Ų³ĪŻ